| Беларусь, Минск |

Рекуррентные сети на базе персептрона

Рекуррентная сеть Эльмана

Рекуррентная сеть Эльмана характеризуется частичной рекуррентностью в

форме обратной связи между скрытым и входным слоем, реализуемой с помощью

единичных элементов запаздывания  . Обобщенная структура этой сети

представлена на рис. 3.

. Обобщенная структура этой сети

представлена на рис. 3.

Каждый скрытый нейрон имеет свой аналог в контекстном слое, образующем

совместно с внешними входами сети входной слой. Выходной слой состоит из

нейронов, однонаправленно связанных только с нейронами скрытого слоя,

подобно сети RMLP. Обозначим внутренний вектор возбуждения сети  (в его

состав входит также единичный сигнал поляризации), состояния скрытых

нейронов -

(в его

состав входит также единичный сигнал поляризации), состояния скрытых

нейронов -  , а выходные сигналы сети -

, а выходные сигналы сети -  . При таких

обозначениях входной вектор сети в момент

. При таких

обозначениях входной вектор сети в момент  имеет форму

имеет форму

![\begin{align*}

X(k) = [x_0(k), x_1(k), \ldots, x_N(k), v_1(k-1), v_2(k-1), \ldots, v_K(k-1)].

\end{align*}](/sites/default/files/tex_cache/e400713ddad51440097bb513b932ab24.png)

Веса синаптических связей первого (скрытого) слоя сети обозначим  ,

a второго (выходного) слоя -

,

a второго (выходного) слоя -  . Если взвешенную

сумму

. Если взвешенную

сумму  -го нейрона

скрытого слоя обозначить

-го нейрона

скрытого слоя обозначить  , а его выходной сигнал -

, а его выходной сигнал -  , то

, то

Веса  образуют матрицу

образуют матрицу  синаптических связей скрытого слоя, а

синаптических связей скрытого слоя, а  - функция активации

- функция активации  -го нейрона этого

слоя. Аналогично можно

обозначить взвешенную сумму

-го нейрона этого

слоя. Аналогично можно

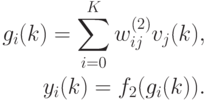

обозначить взвешенную сумму  -го нейрона выходного слоя

-го нейрона выходного слоя  ,

а соответствующий ему выходной сигнал сети -

,

а соответствующий ему выходной сигнал сети -  . Эти сигналы

описываются

формулами

. Эти сигналы

описываются

формулами

В свою очередь, веса  образуют матрицу

образуют матрицу  , описывающую

синаптические связи нейронов выходного слоя;

, описывающую

синаптические связи нейронов выходного слоя;  - функция

активации

- функция

активации  -го нейрона выходного слоя.

-го нейрона выходного слоя.