|

Здравствуйте! 4 июня я записалась на курс Прикладная статистика. Заплатила за получение сертификата. Изучала лекции, прошла Тест 1. Сегодня вижу, что я вне курса! Почему так произошло? |

Статистика нечисловых данных

11.5. Статистика нечетких множеств

Нечеткие множества - частный вид объектов нечисловой природы. Поэтому при обработке выборки, элементами которой являются нечеткие множества, могут быть использованы различные методы анализа статистических данных произвольной природы - расчет средних, непараметрических оценок плотности, построение диагностических правил и т.д.

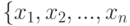

Среднее значение нечеткого множества. Однако иногда используются методы, учитывающие специфику нечетких множеств. Например, пусть носителем нечеткого множества является конечная совокупность действительных чисел  . Тогда под средним значением нечеткого множества иногда понимают число. А именно, среднее значение нечеткого множества определяют по формуле:

. Тогда под средним значением нечеткого множества иногда понимают число. А именно, среднее значение нечеткого множества определяют по формуле:

- функция принадлежности нечеткого множества

- функция принадлежности нечеткого множества  . Если знаменатель равен 1, то эта формула определяет математическое ожидание случайной величины, для которой вероятность попасть в точку

. Если знаменатель равен 1, то эта формула определяет математическое ожидание случайной величины, для которой вероятность попасть в точку  равна

равна  . Такое определение наиболее естественно, когда нечеткое множество

. Такое определение наиболее естественно, когда нечеткое множество  интерпретируется как нечеткое число.

интерпретируется как нечеткое число.Очевидно, наряду с  может оказаться полезным использование эмпирических средних, определяемых (согласно статистике в пространствах общей природы) путем решения соответствующих оптимизационных задач. Для конкретных расчетов необходимо ввести то или иное расстояние между нечеткими множествами.

может оказаться полезным использование эмпирических средних, определяемых (согласно статистике в пространствах общей природы) путем решения соответствующих оптимизационных задач. Для конкретных расчетов необходимо ввести то или иное расстояние между нечеткими множествами.

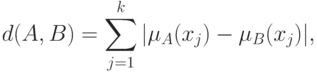

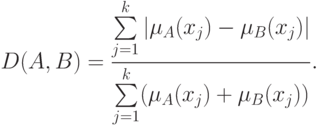

Расстояния в пространствах нечетких множеств. Как известно, многие методы статистики нечисловых данных базируются на использовании расстояний (или показателей различия) в соответствующих пространствах нечисловой природы. Расстояние между нечеткими подмножествами  и

и  множества

множества  можно определить как

можно определить как

- функция принадлежности нечеткого множества

- функция принадлежности нечеткого множества  , а

, а  - функция принадлежности нечеткого множества

- функция принадлежности нечеткого множества  . Может использоваться и другое расстояние:

. Может использоваться и другое расстояние:

(Примем это расстояние равным 0, если функции принадлежности тождественно равны 0.)

В соответствии с аксиоматическим подходом к выбору расстояний (метрик) в пространствах нечисловой природы разработан обширный набор систем аксиом, из которых выводится тот или иной вид расстояний (метрик) в конкретных пространствах, в том числе в пространствах нечетких множеств (см. "Различные виды статистических данных" ). При использовании вероятностных моделей расстояние между случайными нечеткими множествами (т.е. между случайными элементами со значениями в пространстве нечетких множеств) само является случайной величиной, имеющей в ряде постановок асимптотически нормальное распределение [ [ 1.18 ] ].

Проверка гипотез о нечетких множествах. Пусть ответ эксперта - нечеткое множество. Естественно считать, что его ответ, как показание любого средства измерения, содержит погрешности. Если есть несколько экспертов, то в качестве единой оценки (группового мнения) естественно взять эмпирическое среднее их ответов. Но возникает естественный вопрос: действительно ли все эксперты измеряют одно и то же? Может быть, глядя на реальный объект, они оценивают его с разных сторон? Например, на научную статью можно смотреть как с теоретической точки зрения, так и с прикладной, и соответствующие оценки будут скорее всего различны (если они совпадают, то работа либо никуда не годится, либо является выдающейся).

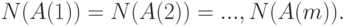

Итак, возник вопрос: как проверить согласованность мнений экспертов? Надо сначала определить понятие согласованности. Пусть  - нечеткий ответ эксперта. Будем считать, что соответствующая функция принадлежности есть сумма двух слагаемых:

- нечеткий ответ эксперта. Будем считать, что соответствующая функция принадлежности есть сумма двух слагаемых:

- "истинное" нечеткое множество, а

- "истинное" нечеткое множество, а  - "погрешность" эксперта как прибора. Естественно рассмотреть две постановки.

- "погрешность" эксперта как прибора. Естественно рассмотреть две постановки.Мнения экспертов  будем считать согласованными, если

будем считать согласованными, если

Рассмотрим две группы экспертов. В первой у всех "истинное" мнение  , а во второй у всех -

, а во второй у всех -  . Две группы будем считать согласованными по мнениям, если

. Две группы будем считать согласованными по мнениям, если

Согласованность определена. Как же ее проверить? Если экспертов достаточно много, то эти гипотезы можно проверять отдельно для каждого элемента множества - общего носителя нечетких ответов. Проверка последней гипотезы переходит в проверку однородности двух независимых выборок ( "Статистический анализ числовых величин" ). Здесь ограничимся постановками основных гипотез (ср. с аналогичными гипотезами, рассмотренными выше для люсианов).

Восстановление зависимости между нечеткими переменными. Рассмотрим две нечеткие переменные  и

и  . Пусть каждый из

. Пусть каждый из  испытуемых выдает в ответ на вопрос два нечетких множества

испытуемых выдает в ответ на вопрос два нечетких множества  и

и  . Необходимо восстановить зависимость

. Необходимо восстановить зависимость  от

от  , другими словами, наилучшим образом приблизить

, другими словами, наилучшим образом приблизить  с помощью

с помощью  .

.

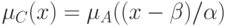

Для иллюстрации основной идеи ограничимся парной линейной регрессией нечетких множеств. Нечеткое множество  назовем линейной функцией от нечеткого множества

назовем линейной функцией от нечеткого множества  , если для любого

, если для любого  из носителя

из носителя  функции принадлежности множеств

функции принадлежности множеств  и

и  таковы, что

таковы, что  при

при  . Другими словами,

. Другими словами,

из носителя

из носителя  . В таком случае естественно писать

. В таком случае естественно писать

Однако нечеткие переменные, как и привычные статистикам числовые переменные, обычно несколько отклоняются от линейной связи. Наилучшее линейное приближение нечеткой переменной  с помощью линейной функции от нечеткой переменной

с помощью линейной функции от нечеткой переменной  естественно искать, решая задачу минимизации по

естественно искать, решая задачу минимизации по  расстояния от

расстояния от  до

до  . Пусть

. Пусть

- некоторое расстояние между нечеткими множествами, а минимизация проводится по всем возможным значениям

- некоторое расстояние между нечеткими множествами, а минимизация проводится по всем возможным значениям  и

и  . Тогда наилучшей линейной аппроксимацией

. Тогда наилучшей линейной аппроксимацией  является

является  . Если рассматриваемый минимум равен 0, то имеет место точная линейная зависимость.

. Если рассматриваемый минимум равен 0, то имеет место точная линейная зависимость.Для восстановления зависимости по выборочным парам нечетких переменных естественно воспользоваться подходом, развитым в статистике в пространствах произвольной природы для параметрической регрессии (аппроксимации). В соответствии с 6.3 в качестве наилучших оценок параметров линейной зависимости следует рассматривать

Тогда наилучшим линейным приближением  является

является  .

.

Вероятностно-статистическая теория регрессионного анализа нечетких переменных строится как частный случай аналогичной теории для переменных произвольной природы (см.6.3). В частности, при обычных предположениях оценки  являются состоятельными, т.е.

являются состоятельными, т.е.  и

и  при

при  .

.

Кластер-анализ нечетких переменных. Строить группы сходных между собой нечетких переменных (кластеры) можно многими способами. Опишем два семейства алгоритмов.

Пусть на пространстве, в котором лежат результаты наблюдений, т.е. на пространстве нечетких множеств, заданы две меры близости  и

и  (например, это могут быть введенные выше расстояния

(например, это могут быть введенные выше расстояния  и

и  ). Берется один из результатов наблюдений (нечеткое множество) и вокруг него описывается шар радиуса

). Берется один из результатов наблюдений (нечеткое множество) и вокруг него описывается шар радиуса  , определяемый мерой близости

, определяемый мерой близости  . (Напомним, что шаром с центром в

. (Напомним, что шаром с центром в  относительно

относительно  называется множество всех элементов

называется множество всех элементов  рассматриваемого пространства таких, что

рассматриваемого пространства таких, что  .) Берутся результаты наблюдений (элементы выборки), попавшие в этот шар, и находится их эмпирическое среднее относительно второй меры близости

.) Берутся результаты наблюдений (элементы выборки), попавшие в этот шар, и находится их эмпирическое среднее относительно второй меры близости  . Оно берется за новый центр, вокруг которого снова описывается шар радиуса

. Оно берется за новый центр, вокруг которого снова описывается шар радиуса  относительно

относительно  , и процедура повторяется.

(Чтобы алгоритм был полностью определен, необходимо сформулировать правило выбора элемента эмпирического среднего в качестве нового центра, если эмпирическое среднее состоит более чем из одного элемента.)

, и процедура повторяется.

(Чтобы алгоритм был полностью определен, необходимо сформулировать правило выбора элемента эмпирического среднего в качестве нового центра, если эмпирическое среднее состоит более чем из одного элемента.)

Когда центр шара зафиксируется (перестанет меняться), попавшие в этот шар элементы объявляются первым кластером и исключаются из дальнейшего рассмотрения. Алгоритм применяется к совокупности оставшихся результатов наблюдений, выделяет из нее второй кластер и т.д.

Всегда ли центр шара остановится? При реальных расчетах в течение многих лет так было всегда. Соответствующая теория была построена в 1977 г. [  ]. Было доказано, что описанный выше процесс всегда остановится через конечное число шагов. Причем число шагов до остановки оценивается через максимально возможное число результатов наблюдений в шаре радиуса

]. Было доказано, что описанный выше процесс всегда остановится через конечное число шагов. Причем число шагов до остановки оценивается через максимально возможное число результатов наблюдений в шаре радиуса  относительно

относительно  .

.

Обширное семейство образуют алгоритмы кластер-анализа типа "Дендрограмма", известные также под названием "агломеративные иерархические алгоритмы средней связи". На первом шагу алгоритма из этого семейства каждый результат наблюдения рассматривается как отдельный кластер. Далее на каждом шагу происходит объединение двух самых близких кластеров. Название "Дендрограмма" объясняется тем, что результат работы алгоритма обычно представляется в виде дерева. Каждая его ветвь соответствует кластеру, появляющемуся на каком-либо шагу работы алгоритма. Слияние ветвей соответствует объединению кластеров, а ствол - заключительному шагу, когда все наблюдения оказываются объединенными в один кластер.

Для работы алгоритмов кластер-анализа типа "Дендрограмма" необходимо определить расстояние между кластерами. Естественно использовать ассоциативные средние, которыми, как известно, являются обобщенные средние по Колмогорову всевозможных попарных расстояний между элементами двух рассматриваемых кластеров. Итак, расстояние между кластерами  и

и  , состоящими из

, состоящими из  и

и  элементов соответственно, определяется по формуле:

элементов соответственно, определяется по формуле:

- некоторое расстояние между нечеткими множествами,

- некоторое расстояние между нечеткими множествами,  - строго монотонная функция (строго возрастающая или строго убывающая).

- строго монотонная функция (строго возрастающая или строго убывающая).Соображения теории измерений позволяют ограничить круг возможных алгоритмов типа "Дендрограмма". Естественно принять, что единица измерения расстояния выбрана произвольно. Тогда согласно результатам  5.3 из всех обобщенных средних по Колмогорову годятся только степенные средние, т.е.

5.3 из всех обобщенных средних по Колмогорову годятся только степенные средние, т.е.  при

при  или

или  . Чтобы получить разбиение на кластеры, надо "разрезать" дерево на определенной высоте, т.е. объединять кластеры лишь до тех пор, пока расстояние между ними меньше заранее выбранной константы. При альтернативном подходе заранее фиксируется число кластеров. Рассматривают и двухкритериальную постановку, когда минимизируют сумму (или максимум) внутрикластерных разбросов и число кластеров.

Для решения задачи двухкритериальной минимизации либо один из критериев заменяют на ограничение, либо два критерия "свертывают" в один, либо применяют иные подходы (последовательная оптимизация, построение поверхности Парето и др.).

. Чтобы получить разбиение на кластеры, надо "разрезать" дерево на определенной высоте, т.е. объединять кластеры лишь до тех пор, пока расстояние между ними меньше заранее выбранной константы. При альтернативном подходе заранее фиксируется число кластеров. Рассматривают и двухкритериальную постановку, когда минимизируют сумму (или максимум) внутрикластерных разбросов и число кластеров.

Для решения задачи двухкритериальной минимизации либо один из критериев заменяют на ограничение, либо два критерия "свертывают" в один, либо применяют иные подходы (последовательная оптимизация, построение поверхности Парето и др.).

При классификации нечетких множеств полезны многие подходы, рассмотренные в "Многомерный статистический анализ" , а именно, все подходы, основанные только на использовании расстояний.

Сбор и описание нечетких данных. Разработано большое количество процедур описания нечеткости. Так, согласно Э.Борелю понятие "куча" описывается с помощью функции распределения - при каждом конкретном  значение функции принадлежности - это доля людей, считающих совокупность

значение функции принадлежности - это доля людей, считающих совокупность  зерен кучей. Результат подобного опроса может дать и кривую иного вида, например, по поводу понятия "молодой" (слева будут отделены "дети", а справа - "люди зрелого и пожилого возраста"). Нечеткая толерантность может оцениваться с помощью случайных толерантностей (см. выше).

зерен кучей. Результат подобного опроса может дать и кривую иного вида, например, по поводу понятия "молодой" (слева будут отделены "дети", а справа - "люди зрелого и пожилого возраста"). Нечеткая толерантность может оцениваться с помощью случайных толерантностей (см. выше).

Целесообразно попытаться выделить наиболее практически полезные простые формы функций принадлежности. Видимо, наиболее простой является "ступенька" - внутри некоторого интервала функция принадлежности равна 1, а вне этого интервала равна 0. Это - простейший способ "размывания" числа путем замены его интервалом. Нечеткое множество описывается двумя числами - концами интервала. Оценки этих чисел можно получить с помощью экспертов. Статистическая теория подобных нечетких множеств рассмотрена в "Статистика интервальных данных" .

Тремя числами  описывается функция принадлежности типа треугольника. При этом левее

описывается функция принадлежности типа треугольника. При этом левее  и правее с функция принадлежности равна 0. В точке

и правее с функция принадлежности равна 0. В точке  функция принадлежности принимает значение 1. На отрезке

функция принадлежности принимает значение 1. На отрезке ![[a; b]](/sites/default/files/tex_cache/65c152d51ed08a1761f5a8cb653eafe5.png) функция принадлежности линейно растет от 0 до 1, а на отрезке

функция принадлежности линейно растет от 0 до 1, а на отрезке ![[b;c]](/sites/default/files/tex_cache/2543f3b3760c319873d36a852c39026e.png) - линейно убывает от 1 до 0. Оценки трех чисел

- линейно убывает от 1 до 0. Оценки трех чисел  получают при опросе экспертов.

получают при опросе экспертов.

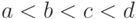

Следующий по сложности вид функции принадлежности - типа трапеции - описывается четырьмя числами  . Левее

. Левее  и правее

и правее  функция принадлежности равна 0. На отрезке

функция принадлежности равна 0. На отрезке ![[a; b]](/sites/default/files/tex_cache/65c152d51ed08a1761f5a8cb653eafe5.png) она линейно возрастает от 0 до 1, на отрезке

она линейно возрастает от 0 до 1, на отрезке ![[b; c]](/sites/default/files/tex_cache/e75809c02c43b2bb05597c0a82d5c30b.png) во всех точках равна 1, а на отрезке

во всех точках равна 1, а на отрезке ![[c; d]](/sites/default/files/tex_cache/6022cfb84dd0f0645ce4ee4a4492ac09.png) линейно убывает от 1 до 0. Для оценивания четверки чисел

линейно убывает от 1 до 0. Для оценивания четверки чисел  используют экспертов.

используют экспертов.

Ряд результатов статистики нечетких данных приведен в первой монографии российского автора по нечетким множествам [ [ 1.16 ] ] и во многих дальнейших публикациях.